2030 年「無用階級」誕生?當 Agentic AI 接管決策,政府與勞工的最後防線

摘要

隨著人工智慧技術從生成式(Generative)邁向代理式(Agentic),全球勞動力市場正面臨自工業革命以來最深刻的結構性崩解。矽谷傳奇投資人 Vinod Khosla 預測,到 2030 年,AI 將有能力取代 80% 的工作崗位,這一預測的驚人之處在於它不再將取代範圍侷限於藍領或基層白領,而是直指企業權力核心——包含執行長(CEO)在內的高階管理職位。本報告基於對全球技術趨勢、企業案例與政策辯論的詳盡分析,深入探討了為何 AI 的替代效應將不可避免地向上游蔓延。透過分析中國網龍網絡任命 AI 為輪值 CEO 的實證案例,以及 Agentic AI 在多步驟推理與戰略規劃上的技術突破,我們論證了高階管理職能的算法化已成定局。然而,技術的飛躍暴露了治理架構的嚴重滯後。從韓國縮減自動化稅收抵免的「隱形機器人稅」實驗,到歐盟對 AI 稅收提案的否決,顯示出各國政府在「鼓勵創新」與「保護就業」之間的戰略迷航。報告進一步剖析了若轉型失敗所帶來的社會風險,特別是 Yuval Noah Harari 所警示的「無用階級」(Useless Class)興起——這不僅是經濟上的被剝奪,更是存在主義層面的身份喪失。本研究最終提出,唯有透過激進的社會契約重構,包括建立基於 AI 紅利的財富分配機制(如 UBI)與「彈性安全」(Flexicurity)勞動制度,人類社會才能在演算法時代避免走向極端分化與崩潰。

前言:認知工業革命與人類價值的重新定義

在人類歷史的長河中,技術進步往往被視為釋放生產力、提升生活品質的引擎。從蒸汽機到互聯網,每一次技術革命雖然都伴隨著短期的陣痛與職業更迭,但最終都創造了更多的工作機會與更高的經濟價值。然而,當我們站在 2025 年的時間節點上,面對以「代理式人工智慧」(Agentic AI)為代表的新一輪技術浪潮,歷史的規律似乎正在失效。這一次,機器不再僅僅是人類肌肉力量的延伸,也不再只是被動的資訊處理工具,它們開始介入、甚至接管人類最引以為傲的領域——認知判斷、戰略規劃與執行意圖。

矽谷風險投資家、OpenAI 的早期支持者 Vinod Khosla 提出了一個令傳統經濟學家與政策制定者不寒而慄的預測:在未來 10 年內,AI 將有能力執行 80% 的現有工作,且其執行效率與成本效益將遠超人類。這一預測並非孤立的危言聳聽,而是得到了 Anthropic CEO Dario Amodei 等業內領袖的共鳴,他們警告 AI 的能力提升呈現指數級增長,而社會適應能力卻仍停留在線性發展階段,兩者之間的巨大鴻溝(Lag)將是未來社會動盪的主要根源。

這場「認知工業革命」的核心特徵在於其「無孔不入」的滲透性。過去,自動化主要威脅的是重複性高、規則明確的體力勞動或基層文書工作;而現在,Agentic AI 憑藉著大型語言模型(LLM)的推理能力與工具調用能力,正在攻破曾經被認為是人類堡壘的「非例行性認知任務」(Non-routine Cognitive Tasks)。從編寫複雜法律合約的律師,到診斷罕見疾病的醫生,甚至到掌舵跨國企業的執行長,沒有任何一個職業能宣稱自己擁有絕對的「護城河」。

本報告旨在透過深度研究與多維度分析,回應 Business Insider 報導所引發的關鍵問題:為何連 CEO 這樣的高階職位也難逃被取代的命運?面對即將到來的就業海嘯,政府與勞工應如何準備?以及,如果我們未能及時完成社會轉型,將面臨何種災難性的後果?我們將透過三個核心洞察(Insights),層層剖析這場變革的技術邏輯、治理困境與社會風險,並試圖為這個不確定的未來描繪出一幅可行的導航圖。

Insight 1: 金色寶座的崩塌——為何 CEO 與高階主管不再免疫

「決策不再是人類獨有的魔法,而是一種可被優化的計算;當 AI 能以更低的成本、更少的偏見、全天候地執行這項計算時,CEO 的光環將隨之消散,取而代之的是極致理性的算法治理。」

1.1 解構 CEO 的神話:從「領導藝術」到「算法優化」

長期以來,執行長(CEO)的角色被包裹在一層神秘的「領導藝術」光環之中。人們普遍認為,CEO 所需的戰略眼光、直覺判斷、複雜人際協調以及在高度不確定性下做決策的能力,是機器無法複製的「人類特質」。然而,隨著數據科學與管理學的深度融合,我們開始意識到,CEO 的許多核心職能——資訊綜合、風險評估、資源分配——在本質上是高度依賴數據輸入與邏輯推演的「最佳化問題」(Optimization Problems)。

McKinsey 的一項研究曾指出,CEO 約 25% 的工作時間花在可被現有技術完全替代的任務上,如財務報告審閱、例行會議與基礎數據分析。然而,隨著 Agentic AI 的引入,這一比例的評估正在發生劇烈的動態變化。Agentic AI 不同於傳統的生成式 AI,它不僅能生成文本或報告,更具備了「自主性」(Agency)。這意味著它能像人類管理者一樣,將一個宏大的戰略目標(如「在 2026 年前將亞太區市場份額提升 15%」)自主拆解為數百個具體的執行步驟(如「優化供應鏈庫存周轉率」、「動態調整社交媒體廣告預算」、「重新談判非核心供應商合約」),並調用相應的數位工具去執行這些步驟,過程中還能根據即時反饋進行自我修正。

在這種技術背景下,我們必須重新審視 CEO 的職能。戰略規劃(Strategic Planning)往往被視為 CEO 的最高價值所在,但人類在進行戰略規劃時,受限於「有限理性」(Bounded Rationality):我們的認知頻寬有限,只能處理少量的變量;我們容易受沈沒成本謬誤(Sunk Cost Fallacy)影響,難以割捨失敗的專案;我們的情緒與個人偏好往往會干擾客觀判斷。相比之下,AI 系統能夠同時模擬數百萬種市場情境,基於全球範圍內的實時數據(從地緣政治新聞到競爭對手的專利申請)進行動態博弈分析,並給出數學上最優的決策路徑。當「直覺」被證明只是「尚未被解析的數據模式」時,AI 在戰略制定上的優勢將壓倒性地超越人類。

1.2 實證案例:AI 進入董事會與 C-Suite 的先聲

這並非遙遠的未來學猜想,而是正在發生的商業現實。全球範圍內,已有先驅企業開始實驗將 AI 引入最高決策層,其結果令人深思。

案例一:網龍網絡(NetDragon Websoft)與 AI CEO 唐鈺(Tang Yu)

2022 年 8 月,中國知名的網路遊戲與教育公司網龍網絡宣布任命一位名為「唐鈺」的 AI 虛擬人擔任其旗艦子公司的輪值 CEO。這一舉動最初被外界視為行銷噱頭,但隨後的運營數據卻展示了其真實的商業邏輯。唐鈺並非僅是一個虛擬形象,而是一個集成了公司即時大數據的決策中樞。

- 職能範圍:唐鈺負責審批各類單據、評估員工績效、優化專案流程,甚至參與人才的招聘與解僱決策。它能 24 小時不間斷地監控公司運營狀態,實時發現潛在的風險點並發出預警。

- 績效表現:數據顯示,在唐鈺任職期間,網龍網絡的股價表現優於香港恆生指數大盤。公司聲稱,AI CEO 的引入顯著提升了審批效率,降低了管理成本,並透過數據驅動的客觀評估,提升了員工評價的公平性。

- 意義:唐鈺的案例證明了,對於一家高度數位化的企業而言,最高管理者不一定需要實體肉身。AI 在處理海量營運數據、維持流程標準化與執行效率方面,展現出了人類無法比擬的穩定性。

案例二:Deep Knowledge Ventures 與演算法董事 VITAL

早在 2014 年,香港風險投資公司 Deep Knowledge Ventures 就任命了一個名為 VITAL(Validating Investment Tool for Advancing Life Sciences)的演算法系統為董事會成員,並賦予其在投資決策上的投票權。

- 運作機制:VITAL 透過掃描海量的生命科學研究論文、臨床試驗數據、專利資料庫以及競爭對手的財務狀況,來評估潛在投資標的的風險與回報率。

- 決策權力:VITAL 的「一票」並非象徵性的。公司創始人明確表示,若 VITAL 投下反對票,公司將不會推進該項投資。這標誌著機器首次在法律與公司治理層面獲得了與人類董事平起平坐的地位。

- 結果:該公司隨後成功避開了多個高風險項目,並在再生醫學領域取得了一系列成功投資,驗證了演算法在高度複雜、專業化領域的決策能力遠超人類直覺。

案例三:Dictador 與機器人 CEO Mika

波蘭朗姆酒品牌 Dictador 任命了由 Hanson Robotics 製造的類人機器人 Mika 為 CEO。Mika 不僅負責數據分析與戰略決策,還擔任品牌代言人,負責與媒體互動。雖然 Mika 的象徵意義可能大於實質管理意義,但它進一步模糊了人類管理者與機器管理者的界線,並引發了關於「品牌人格化」與 AI 代理關係的討論。

1.3 經濟邏輯:消除代理問題(Agency Problem)與成本結構重組

從公司治理(Corporate Governance)的深層經濟邏輯來看,AI 取代 CEO 具有強大的驅動力,這主要體現在消除「代理問題」上。

在現代股份制企業中,股東(委託人)與 CEO(代理人)之間存在著天然的利益衝突。CEO 也是人,他們可能為了追求短期獎金而犧牲公司長期利益(如削減研發預算以美化當期財報),可能為了構建個人帝國而進行無效的併購,或者因個人好惡而任人唯親。為了監督與激勵 CEO,股東必須支付高昂的代理成本(Agency Costs),包括天價薪酬、股權激勵以及昂貴的審計費用。

AI CEO 的出現,從理論上徹底解決了這一問題:

- 利益絕對一致:AI 沒有私慾,沒有退休金需求,也不會追求社會地位。它能被編程為嚴格遵守股東設定的目標函數(如長期股東價值最大化、ESG 指標達標等),從根本上消除了道德風險。

- 極致的成本效益:標普 500 企業 CEO 的平均薪酬已達數千萬美元,而一套頂級企業級 AI 系統的運行成本僅為其零頭。對於追求利潤最大化的資本而言,用 AI 替代高薪且充滿不確定性的人類高管,具有極大的財務吸引力。

- 消除資訊不對稱:人類 CEO 往往依賴下屬層層上報的資訊,這些資訊在傳遞過程中難免被過濾、扭曲或美化(信息熵)。AI CEO 則能直接接入企業的 ERP、CRM 與 IoT 系統,擁有「上帝視角」般的數據透明度,決策基於原始事實而非經過加工的報告。

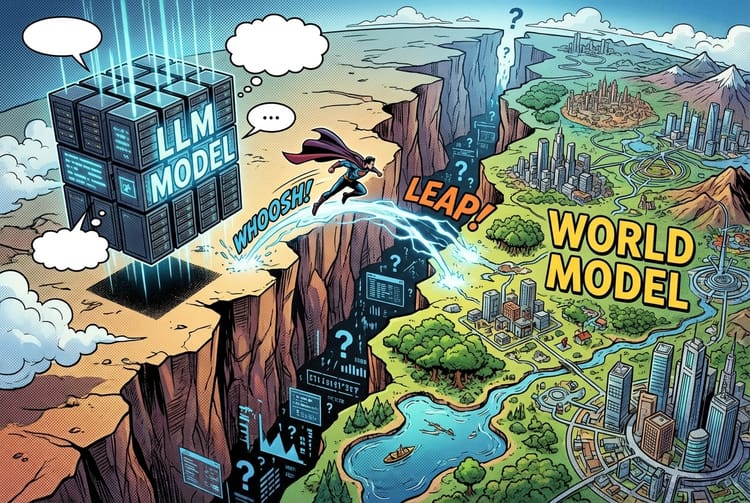

1.4 Agentic AI 的技術賦能:為何這一次不同?

過去的 AI 是「工具」(Tool),現在的 AI 是「代理」(Agent)。這一轉變是革命性的。

McKinsey 提出的「超機構」(Superagency)概念指出,新一代 AI 模型具備了**推理(Reasoning)與規劃(Planning) 的能力。

- 多步驟推理:面對「解決供應鏈中斷」這樣的模糊指令,Agentic AI 能將其拆解為:1. 掃描全球氣象與航運數據定位中斷源;2. 查詢庫存系統評估影響範圍;3. 搜索替代供應商並比價;4. 自動發送詢價單;5. 根據預設權限生成採購訂單供審核。這種端到端的執行能力,直接覆蓋了從中層經理到高層主管的大部分職能。

- 跨工具協作:Agentic AI 能熟練使用各種企業軟體(SAP, Salesforce, Slack),甚至能編寫代碼來連接不同系統,填補了企業內部長期存在的「數據孤島」,實現了流程的自動化閉環。

表 1:CEO 核心職能的人類與 Agentic AI 能力深度對比

| CEO 核心職能 | 人類 CEO 的侷限性 (Bounded Rationality) | Agentic AI 的優勢 (Computational Superiority) | 取代/協作潛力 |

|---|---|---|---|

| 戰略規劃 (Strategic Planning) | 依賴有限的經驗與直覺;易受認知偏誤(如過度自信、確認偏誤)影響;決策週期長(季/年)。 | 基於全量數據進行蒙特卡羅模擬(Monte Carlo Simulation);無情感偏誤;能進行實時動態戰略調整(Real-time Strategy)。 | 高 (AI 提供選項,人類做最終價值判斷) |

| 資源配置 (Resource Allocation) | 易受部門政治角力與人際關係影響;難以精確評估跨部門 ROI。 | 純粹基於數學優化模型分配預算與人力;實現資源利用率最大化;動態調度資源以應對市場波動。 | 極高 (完全自動化潛力大) |

| 風險管理 (Risk Management) | 關注顯性風險,常忽略「黑天鵝」或複雜系統的非線性連鎖反應;反應滯後。 | 全天候監控全球多模態數據(新聞、衛星圖像、社交輿情);識別微弱信號(Weak Signals);具備預測性維護與危機預警能力。 | 極高 (AI 監控,人類介入處理) |

| 營運監控 (Operational Oversight) | 依賴滯後的 KPI 儀表板與層級匯報;存在監控盲區。 | 直接接入業務系統底層;實現流程挖掘(Process Mining)與自動異常檢測;透明度 100%。 | 極高 (完全自動化) |

| 情感領導 (Emotional Leadership) | 具備同理心、激勵團隊、建立信任、處理複雜的人際衝突與道德兩難。 | 目前僅能模擬情感反應(Affective Computing);缺乏真實的意識與道德責任主體;難以在危機中給予人類深層的安全感。 | 低 (人類的核心護城河) |

| 法律責任 (Legal Liability) | 作為法人代表承擔法律責任(如簽字負責)。 | AI 無法成為法律主體(目前);無法坐牢或承擔刑事責任。 | 低 (需人類承擔最終責任) |

結論: CEO 職位不會在一夜之間消失,但正在經歷「空心化」與「重構」。未來的 CEO 將不再是獨斷專行的指揮官,而更像是「人機混合系統」的架構師(Architect)。他們的工作將從「做決策」轉變為「定義決策的邊界與邏輯」,即設定 AI 的目標函數、倫理參數與風險閾值。那些拒絕將決策權讓渡給 AI 的傳統 CEO,將如同堅持手工記帳的會計師一樣,被效率的洪流無情淘汰。

Insight 2: 治理缺口與勞工的最後防線——政策緊急狀態

「當『終身學習』趕不上『終身淘汰』的速度時,我們需要的不是修補舊的社會安全網,而是編織一張全新的社會契約;這是一場關於分配正義的競賽,對手是指數級進化的演算法。」

2.1 轉型速度的錯配:線性政策 vs. 指數級技術

當前全球社會面臨的最大風險,並非 AI 最終是否會取代所有工作,而在於替代發生的速度(Velocity of Displacement),遠遠超過了社會創造新就業、教育體系培養新技能以及政府建立新安全網的速度 13。

Vinod Khosla 關於「5 年內 80% 工作被取代」的預言揭示了一個數學上的殘酷現實:技術進步是指數級的(Exponential),而人類社會的適應、法律的修訂、教育的改革則是線性的(Linear)。這種「速度錯配」將導致一個巨大的治理缺口(Governance Gap)。在這個缺口中,數以億計的勞動者可能被拋入缺乏保障的深淵。

現行的主流政策——「再培訓」(Reskilling)與「終身學習」(Lifelong Learning)——在 Agentic AI 面前顯得蒼白無力。

- 技能半衰期的坍縮:過去,一項專業技能(如 Java 編程)可能保證 10 年的穩定就業。現在,隨著 AI 寫代碼能力的進化,從初級程式設計師到提示工程師(Prompt Engineer)的需求轉變僅在兩年內發生,而提示工程師本身也可能在下一代自優化模型出現後迅速過時。要求一名 45 歲的被裁卡車司機轉型為 AI 訓練師,不僅面臨巨大的學習曲線挑戰,更面臨「學成即失業」的風險。

- 認知天花板的殘酷性:並非所有勞動力都具備從事高階創意或複雜情感勞動的資質。政策制定者往往忽視了人類智力與性格特質的分佈常態,盲目推動高階技能培訓可能導致大量的「結構性失敗」。

2.2 機器人稅(Robot Tax):阻礙創新還是必要之惡?

為了應對自動化帶來的稅基流失(機器人不繳納所得稅與社保)以及籌措巨大的社會轉型資金,全球範圍內關於「機器人稅」的辯論日益激烈。這不只是財政問題,更是調節技術擴散速度的政策工具。

- 比爾·蓋茲的提案與邏輯:比爾·蓋茲是機器人稅最著名的支持者。他認為,如果在工廠工作的工人創造了 5 萬美元的價值並為此繳稅,那麼替代他的機器人也應該繳納同等水平的稅款。這筆資金應專款專用於資助那些「人類專屬」的工作,如長者照護、兒童教育與社區服務。蓋茲的核心邏輯在於,透過稅收稍微減緩自動化的速度,可以為社會爭取寶貴的喘息與適應時間,避免劇烈的社會動盪。

- 韓國的「隱形機器人稅」實驗:作為全球工業機器人密度最高的國家之一,韓國政府在 2017 年採取了實際行動。雖然沒有直接開徵名為「機器人稅」的新稅種,但韓國政府縮減了企業投資自動化設備的稅收抵免優惠。這一政策變動被視為全球首個旨在減緩自動化對就業衝擊的財政干預,標誌著政府態度從「無條件支持自動化」轉向「審慎平衡就業」。

- 歐盟的猶豫與反對:與韓國不同,歐洲議會在 2017 年就是否開徵機器人稅進行了投票,最終否決了該提案。反對者(包括國際機器人聯合會 IFR)的主要論點是:機器人是生產工具,對工具徵稅會阻礙創新,導致歐盟企業在全球競爭中處於劣勢,甚至引發資本外逃到不徵稅的國家。他們主張應該對自動化帶來的「超額利潤」徵稅,而非對技術本身設限。

深度分析:機器人稅在實施上面臨巨大的技術性難題——如何定義「機器人」?實體機械臂容易定義,但一個由軟體驅動的 RPA(機器人流程自動化)系統取代了 10 個會計師,這算不算機器人?AI 聊天機器人取代了客服,算不算機器人?如果僅對實體機器人徵稅,企業將轉向純軟體自動化,這同樣會導致失業。因此,未來的稅制改革方向可能不是針對具體的硬體,而是轉向自動化紅利稅或數位附加價值稅,即根據企業的人均產值或利潤率與行業平均水平的偏差來徵稅,直接從 AI 產生的效率紅利中提取資源。

2.3 全民基本收入(UBI):從烏托邦空想到生存必需品

隨著 AI 可能導致勞動價值與人類生存脫鉤,UBI(Unconditional Basic Income,無條件基本收入)正從邊緣的社會主義烏托邦構想,轉變為矽谷精英與經濟學家眼中的「生存必需品」。

- 經濟循環的必要條件:如果 AI 奪走了大部分工作,工資收入佔 GDP 的比重將大幅下降。在一個消費驅動的經濟體中,如果大眾沒有收入,誰來購買 AI 生產的廉價商品與服務?UBI 在此情境下,不僅是人道主義救濟,更是維持資本主義經濟循環不致崩潰的「流動性注入」機制。

- 矽谷的社會實驗:OpenAI CEO Sam Altman 支持的 OpenResearch 進行了美國史上規模最大的 UBI 實驗。結果顯示,每月無條件發放現金能顯著提升受試者的身心健康、減少飢餓感,並增加了他們嘗試創業或進修的意願,而並未導致反對者所擔心的「大規模懶惰」。這為 UBI 提供了重要的實證支持。

- 財源與實施挑戰:Vinod Khosla 認為,當 AI 讓 GDP 大幅增長(高盛預測 AI 將在 10 年內使全球 GDP 增加 7% 即 7 兆美元)且商品服務成本因自動化而大幅下降時,國家將有足夠的財力負擔 UBI。前美國總統參選人 Andrew Yang 則提出了具體的融資方案,包括徵收「數據支票」(Data Check)或「AI 稅」,讓公眾分享科技巨頭利用公共數據訓練模型所產生的收益。

2.4 新的社會契約:彈性安全(Flexicurity 2.0)

除了 UBI,勞動市場的制度設計也必須進行徹底的範式轉移。借鑒丹麥的「彈性安全」模式,未來的政策應聚焦於保護人,而非保護工作(Protecting people, not jobs)。

- 便攜式福利(Portable Benefits):在零工經濟與專案制工作成為常態的未來,健康保險、退休金、失業保險必須與特定雇主解綁,成為跟隨勞動者個人的「數位背包」。無論是為 Uber 開車、為 AI 進行數據標註,還是從事臨時護理工作,福利積累都不應中斷。

- 政府作為「最後雇主」(Employer of Last Resort):在私人市場無法提供足夠就業崗位時,政府應承擔起創造就業的責任。這並非是為了「挖坑填坑」,而是投資於那些 AI 暫時無法取代、且具備高度正外部性的領域,如社區照護、環境修復、城市美化與人文陪伴。這些工作能提供 UBI 無法提供的「社會參與感」與「意義感」。

結論: 治理缺口是當前最大的系統性風險。政府必須放棄將「失業率」作為衡量經濟健康的單一指標,因為在 AI 時代,高失業率可能與高 GDP 並存。政策的重心必須從傳統的「創造就業」轉向更為激進的「財富再分配」與「尊嚴保障」。

Insight 3: 「無用階級」的幽靈與社會脆弱性

「比被剝削更可怕的,是被遺忘。當 AI 讓人類連被剝削的價值都失去時,我們將面臨人類歷史上最深刻的存在主義危機;這不是階級鬥爭,而是物種分化的前奏。」

3.1 定義「無用階級」(The Useless Class)

歷史學家 Yuval Noah Harari 提出的「無用階級」概念,是理解 AI 社會風險的核心鑰匙。這裡的「無用」並非指這些人對家人或朋友無用,而是指在宏觀的經濟與政治體系中,他們失去了價值。

在過去的工業社會,無論工人受到何種剝削,他們至少是經濟機器中不可或缺的螺絲釘,因此他們擁有罷工、談判與政治動員的力量。然而,在 Agentic AI 時代,當機器能在體力、腦力甚至部分情感勞動上以更低的成本超越人類時,一大群人將面臨一個全新的困境:他們不僅是失業(Unemployed),而是不可被僱用(Unemployable)。這意味著,即使經過培訓,他們所能創造的經濟價值仍低於維持他們生存所需的成本(與機器的運行成本相比)。這是一個經濟學上的死局。

3.2 心理與社會的雙重崩潰機制

工作在現代世俗社會中扮演了過去宗教的角色——它賦予生活意義、結構與社會地位。當工作消失,其後果將遠超經濟範疇。

- 習得性無助(Learned Helplessness)與心理危機:研究表明,長期失業對心理健康的破壞力巨大。根據 Kim 和 von dem Knesebeck 的研究,失業顯著增加了憂鬱症與自殺的風險。更深層的危機在於「習得性無助」——當個體發現無論自己如何努力學習新技能,都無法趕上 AI 的進化速度時,他們會陷入一種深刻的絕望與被動,這種集體的心理崩潰將導致社會充滿戾氣與虛無主義。

- 社會原子化與意義的真空:工作場所往往是現代人建立社會連結、獲取歸屬感的重要場域。失去工作可能導致社區關係的斷裂。Harari 曾激進地(或許是諷刺地)預言,社會可能試圖通過「藥物與沈浸式電腦遊戲(元宇宙)」來安撫這一階級,讓他們在虛擬世界中尋找虛假的成就感與連結。這描繪了一幅《美麗新世界》式的反烏托邦圖景:一群被精心飼養但毫無自由意志與現實影響力的人類。

3.3 不平等的極化:神人(Homo Deus) vs. 無用階級

AI 與生物技術的結合,可能將人類物種從生物學意義上撕裂為兩個階級。

- AI 擁有者(The AI Elite / Homo Deus):掌握演算法、算力、數據與資本的極少數精英。他們將利用 AI 來增強自己的智力,利用生物技術來延長壽命與增強體能。他們將成為字面意義上的「神人」,在認知能力與生命形態上遠超普通人類。

- 數據農奴與邊緣人:其餘的大多數人,最初可能作為提供數據的「礦藏」而存在。但隨著合成數據(Synthetic Data)技術的成熟,AI 對人類真實數據的依賴也會降低。屆時,這群人可能連作為「數據農奴」的價值都會失去,成為純粹的社會負擔。

這種極端的不平等將使傳統的民主制度面臨崩潰。民主制度的前提是「人人生而平等」且每個公民都對國家有價值(納稅、當兵、勞動)。當一小群人掌握了絕大多數的生產力與暴力機器(自動化武器),且不再依賴大眾的勞動時,他們是否還會願意維持民主制度與福利體系?這是一個巨大的問號。

3.4 轉型過慢的社會風險:動盪與盧德主義的復興

如果政府與社會未能及時建立應對機制(如 UBI、尊嚴保障),我們將面臨劇烈的社會動盪:

- 盧德主義(Luddism)的暴力復興:歷史上的盧德運動是紡織工人砸毀機器。在未來,被邊緣化的人群可能攻擊無人駕駛車輛、破壞數據中心、或者針對科技精英進行綁架與暴力抗爭。這種反科技浪潮可能阻礙人類文明的進步,甚至引發內戰。

- 極端政治的崛起:失落、憤怒且感到被遺棄的階級將成為民粹主義、極端民族主義或原教旨主義的溫床。政治強人可能會利用這種憤怒,承諾「砸爛機器」或「回到過去」,從而導致理性的政治秩序瓦解。

- 人口崩潰:在一個競爭絕望、前景黯淡的社會中,理性的個體將拒絕生育。這將加劇人口老齡化,進一步依賴 AI 來填補勞動力缺口,形成一個「越自動化越不生,越不生越依賴自動化」的死循環。

結論: AI 時代的最大風險,不是 AI 產生了意識並主動消滅人類(如《魔鬼終結者》),而是 AI 讓人類覺得自己在這個宇宙中變得多餘。我們必須重新定義「人的價值」。在後工作時代,價值不應再源於「生產力」或「效率」,而應源於「人性」、「創造力」、「關懷」、「哲學思考」與「社區貢獻」。這是一場關於人類靈魂的保衛戰。

總結與行動呼籲 (Conclusion & Call to Action)

總結:穿越風暴的航圖

我們正站在人類文明的十字路口。Vinod Khosla 的預言與 Agentic AI 的崛起,是一個震耳欲聾的警鐘:技術奇點(Singularity)可能比我們預想的更早到來。AI 取代 CEO 的現實表明,沒有任何職業是絕對安全的避風港。這場變革將徹底重寫工作的本質、公司的結構以及社會運行的底層邏輯。

雖然 Agentic AI 帶來的效率提升許諾了一個物質極度豐裕的未來,但通往這個未來的道路上布滿了社會撕裂、心理崩潰與政治動盪的深坑。如果我們繼續沿用舊有的治理思維與社會契約,結局將是災難性的。我們僅剩不到 10 年的時間來完成這場人類歷史上最艱鉅的轉型。

行動呼籲 (Call to Action)

面對這場海嘯,不同利益相關者必須立即採取行動:

1. 對政府與政策制定者:從「管理者」轉向「設計師」

- 立即啟動「AI 紅利稅」與 UBI 試點:不要等待失業潮爆發。現在就開始立法,設計針對 AI 超額利潤或數據使用的稅收機制,並在特定區域進行 UBI 試點,收集關於消費行為、心理健康與社會穩定的實證數據。

- 建立「算法問責」法律框架:明確 AI 決策的法律責任歸屬。當 AI CEO 做出違法決策時,誰該負責?是開發者、使用者還是公司法人?法律必須填補這一真空。

- 推動「以人為本」的教育革命:停止培養「二流機器人」。教育資源應從死記硬背與標準化測試,徹底轉向培養 AI 無法模擬的特質:批判性思維、複雜系統的理解力、藝術審美、高情商協作與哲學思辨。

2. 對企業與董事會:從「效率至上」轉向「人機共生」

- 擁抱「人機混合治理」(Hybrid Governance):不要急於完全去除人類。最佳的決策模式往往是「AI 處理數據 + 人類進行價值判斷」。保留人類在倫理、願景與危機處理上的最終決定權。

- 投資員工的「AI 協作力」:企業的社會責任不再只是捐款,而是確保員工不被淘汰。建立內部學院,培養員工使用、指揮與監管 AI 代理的能力,讓員工從「操作員」升級為「指揮官」。

3. 對個人與勞工:從「工具人」轉向「意義創造者」

- 去魅與賦能:不要神話 AI,也不要恐懼它。主動去了解 Agentic AI 的工作原理與侷限。學習如何寫出好的 Prompt,如何構建工作流,讓 AI 成為你的超級外骨骼。

- 深耕「人性」護城河:專注於那些需要真實情感投入、高度語境理解與道德勇氣的領域。在 AI 時代,最像人的特質(溫暖、不可預測、創造力),才是最稀缺的資源。去愛、去創造、去連結,這些是演算法無法計算的價值。

未來不會自動變好,它需要我們主動去設計。選擇權,目前——也僅僅是目前——還在我們手中。

Member discussion