具身智能的轉捩點:2025 年世界模型、物理智能與數據疆界深度研究報告

1. 摘要:從語言邏輯到物理實體的智能演化

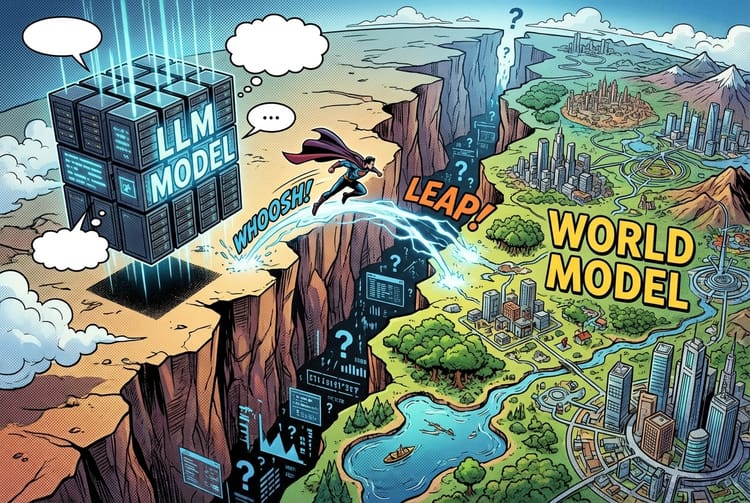

人工智慧的發展軌跡在 2024 至 2025 年間經歷了劇烈的典範轉移。如果說過去十年是大型語言模型(Large Language Models, LLMs)透過掌握語言句法與語意邏輯稱霸的時代,那麼當前則正式進入了「物理智能」(Physical Intelligence)的拓荒期。雖然 LLM 在處理文本生成與邏輯推論上已接近人類水準,但它們本質上仍是「去具身化」(Disembodied)的實體,運作於離散符號的統計關聯中,而非物理對象的因果關係裡。這種侷限性催生了「世界模型」(World Models)的崛起——這是一種不僅僅預測下一個文字,而是旨在預測環境狀態、遵循物理法則、空間幾何與時間連續性的計算框架。

本報告將針對世界模型的研究進度進行詳盡的盤點與分析,深入探討其與 LLM 在本質上的「本體論斷裂」(Ontological Schism)。我們將剖析兩者在訓練資料屬性(邏輯 vs. 物理)及獲取方式(網路爬蟲 vs. 遙操作/模擬)上的根本差異。報告將特別聚焦於具身智能(Embodied AI)的數據瓶頸,探討合成數據(Synthetic Data)與高保真遙操作(Teleoperation)之間的權衡,並以 1X Neo 類人機器人為核心案例,解析其如何透過人為操作構建數據飛輪。分析指出,通往通用人工智慧(AGI)的路徑,在於語言抽象能力與具身感知運動預測的深度融合,這一趨勢正透過如聯合嵌入預測架構(JEPA)與大規模遙操作艦隊等創新工程得以實現。

2. 本體論的斷裂:LLM 與世界模型的本質差異

要理解當前 AI 發展中的摩擦與挑戰,首先必須認知到 LLM 與世界模型在「智能實質」上的根本分歧。這不僅僅是模型架構的差異,更是其所攝取的數據本體論(Ontology)與其所模擬的現實本質之別。

2.1 「訓練資料」的本質:邏輯的壓縮 vs. 物理的連續

AI 模型的認知邊界受限於其訓練資料的本質。LLM 的訓練資料是人類思維的「投影」——文本。文本是一種低維度、離散且高度壓縮的符號系統。它捕捉了邏輯、推理與歷史事實,但剝離了物理語境。當 LLM 處理「玻璃杯掉落」這句話時,它基於統計共現性理解「玻璃杯」、「掉落」與「破碎」之間的語意關聯。然而,它並不理解重力加速度、地面摩擦力、材料的脆性,或物體在時空中連續移動的軌跡。

相比之下,世界模型的訓練資料是高維度、連續的感官流——主要是視頻,並日益整合深度(Depth)、力覺(Force)與本體感覺(Proprioception)數據。世界模型的「訓練資料」即是現實物理本身(或其高保真模擬)。

表 2.1:大型語言模型與世界模型的本體論比較

| 特徵維度 | 大型語言模型 (LLMs) | 世界模型 (World Models) |

|---|---|---|

| 核心表徵 (Representation) | 離散 Token (文字/代碼) | 連續向量 (Latent States/Embeddings) |

| 訓練目標 (Objective) | 下一個 Token 預測 (Autoregressive) | 下一個狀態預測 / 未來滾動 (Future Rollout) |

| 理解類型 (Understanding) | 語意、邏輯、推論性 | 空間、時間、因果、物理性 |

| 數據來源 (Source) | 網路爬取的文本語料庫 | 視頻流、遙操作日誌、物理模擬 |

| 維度 (Dimensionality) | 低維 (文本即壓縮) | 高維 (感官數據極其稠密) |

| 接地性 (Grounding) | 無接地 (純符號操作) | 具身接地 (Sensorimotor Grounding) |

| 失效模式 (Failure Mode) | 幻覺 (Hallucination - 事實錯誤) | 物理違規 (Physical Violation - 物體消失/穿模) |

這種區別至關重要,因為文本是「邏輯的」,允許跳躍;而物理世界是「連續的」,要求守恆。LLM 可以在單次推論中從原因直接跳到結果;世界模型則必須模擬中間狀態以確保物理有效性。這決定了世界模型訓練資料的精髓在於捕捉「動態變化」(Dynamics),而非僅僅是靜態事實。

2.2 學習機制:Next-Token 預測 vs. Next-Latent-State 預測

LLM 的主導方式是自回歸的 Next-Token 預測:$P(w_t | w_{1:t-1})$。模型基於前文歷史預測下一個離散單位的概率。這種方法在語言領域取得了巨大成功,因為可能的 Token 空間(詞彙表)是有限且離散的。

然而,將這種「生成式」方法直接移植到世界模型——即預測視頻幀中的下一個像素——在計算上極其昂貴且理論上存在缺陷。這引發了生成式視頻模型(如 OpenAI 的 Sora)與預測性世界模型(如 Meta 的 JEPA)之間的激烈辯論。

2.2.1 生成式陷阱(The Generative Trap):以 Sora 為例

生成式模型如 Sora 試圖通過生成下一幀的所有像素來模擬世界。雖然在視覺上令人驚嘆,但這種方法在物理領域容易產生「物理幻覺」。模型可能會生成一個人穿過牆壁,或破碎的杯子自動復原的畫面。這些不僅僅是視覺瑕疵,而是模型未能理解物理不變法則的體現。模型往往優先考慮視覺的合理性(紋理、光照),而非物理的一致性。此外,逐像素生成的計算成本極高且效率低落;人類大腦並不預測視網膜接收的每一個光子,而是預測物體的行為與狀態。

2.2.2 預測性解決方案(The Predictive Solution):JEPA 架構

Meta 的首席 AI 科學家 Yann LeCun 提倡 聯合嵌入預測架構(Joint-Embedding Predictive Architectures, JEPA) 作為更優越的替代方案。JEPA 不預測像素,而是預測抽象 潛在空間(Latent Space) 中的世界狀態。

- 編碼器 (Encoder): 系統觀察世界 ($x$) 並將其編碼為表徵 ($s_x$)。

- 預測器 (Predictor): 使用潛在變量 ($z$)——代表不確定性或動作——來預測未來狀態的表徵 ($s_y$)。

- 損失函數 (Loss Function): 模型的訓練目標是最小化預測表徵與實際未來狀態表徵之間的距離,_完全不需要_重建原始像素。

這種「下一個潛在狀態」預測迫使模型學習底層的因果動態(例如:「球正在向下移動」),而非表層的細節(例如:「光線在球表面反射的像素變化」)。LeCun 認為這更接近生物智能的運作方式:發展出一套「常識」物理引擎來預測結果並規劃行動。最新的 V-JEPA(Video-JEPA)已展現出比生成式像素模型更強的物體恆存性與剛體動力學理解能力。

3. 數據獲取的危機:「爬取」物理世界的困境

如果說架構是世界模型的引擎,那麼數據就是燃料。然而,驅動 LLM 革命的數據獲取策略完全不適用於世界模型。我們無法像爬取文本網路那樣簡單地「爬取」物理世界。

3.1 被動視頻的局限:行動標籤的缺失

最初,研究人員寄望於網路上數以億計的視頻(如 YouTube)能成為世界模型的「Common Crawl」。然而,依賴 被動視頻(Passive Video) 造成了根本性的「行動-標籤赤字」(Action-Label Deficit)。

- 本體感覺的缺失 (Missing Proprioception): 一個廚師切洋蔥的視頻展示了視覺結果,但並未包含刀具施加的力、握力大小或洋蔥層的觸覺阻力。

- 行動標籤的缺失 (Missing Action Labels): 當視頻中的汽車左轉時,視頻數據流中並不包含導致該轉向的方向盤角度或煞車踏板壓力。沒有這些「行動標籤」,模型只能學習到 運動學(Kinematics)(物體如何移動),卻無法學習 動力學(Dynamics)(力如何導致移動)。

- 具身差異 (Embodiment Gap): YouTube 視頻中的人手擁有的自由度(DoF)與運動學特性與機器人的末端執行器截然不同。「通過觀察學習」(Learning by Watching)需要極其複雜的轉譯層將人類動作映射到機器人動作,這往往會引入誤差。

3.2 數據來源的分歧:模擬 vs. 遙操作

為了克服被動視頻的局限,該領域分裂為兩大數據獲取策略:模擬(Simulation) 與 遙操作(Teleoperation)。

3.2.1 模擬:無限但不完美的生成器

模擬提供了無限且帶有完美標籤數據的承諾。NVIDIA Isaac Sim、Google 的 Genie 以及各種基於 MuJoCo 的環境允許生成數十億條軌跡,其中每一個力、摩擦係數與動作都是完全已知的。

- 優勢:

- 可擴展性 (Scalability): 可以在 GPU 叢集上並行運行數千個實例。

- 安全性 (Safety): 機器人在模擬中發生災難性失敗(如撞車、摔碎玻璃)不會產生實體成本。

- 極端案例 (Corner Cases): 模擬器可以生成現實中無法合乎道德地收集的危險場景(例如小孩衝入街道)。

- Sim-to-Real 鴻溝: 模擬的阿基里斯之踵在於「Sim-to-Real Gap」。沒有任何模擬器能完美建模現實世界的混沌物理——軟海綿的變形、纜線的糾纏或不可預測的光照條件。純粹在模擬中訓練的模型往往會利用物理引擎的瑕疵(Artifacts)而非學習穩健的行為,導致部署失敗。

- 最新進展: NVIDIA 的 Cosmos 與 Isaac Lab 正試圖透過使用「世界基礎模型」來生成經過物理驗證的合成數據,並利用光照真實的「數位孿生」(Digital Twins)來縮小這一鴻溝。

3.2.2 遙操作:「地面真值」的黃金標準

遙操作涉及人類操作員(通常透過 VR 或模仿套裝)遠程控制機器人執行任務。機器人同時記錄視覺輸入(相機)、本體感覺數據(關節角度、力)與人類的動作(控制指令)。

- 數據匯率 (The Exchange Rate): 研究表明,不同數據類型之間存在巨大的「價值匯率」。一項研究指出,1 小時的高質量遙操作數據在策略性能上等同於約 10 小時甚至更多的模擬數據。

- 有效性來源: 遙操作捕捉了「微動作」與人類直覺——當任務稍微出錯時,人類所做的微妙調整。這種「互動式」數據比被動數據豐富得多。

4. 深度案例分析:1X Neo 與具身數據的收割策略

機器人公司 1X Technologies 及其產品 Neo 代表了「遙操作優先」(Teleoperation-First)構建世界模型的先鋒。與 Tesla 依賴龐大車隊進行「影子模式」數據收集不同,1X 採取了一種將類人機器人部署到家庭環境中,並透過特定策略收割高質量互動數據的路徑。

4.1 數據收集架構:人機協同的閉環

1X Neo 並不依賴初始的全自主性,而是採用「影子操作員」(Shadow Operator)模式。

- 規模化遙操作 (Teleoperation at Scale): 機器人設計為可由人類操作員透過 VR 介面遠程控制。當機器人遇到無法自主解決的任務時,它會請求人類介入。

- 模仿學習 (Imitation Learning): 每當人類操作員執行一項任務(如疊衣服、撿起玩具),機器人都會記錄完整的感官流與相應的運動指令。這些數據被饋送到 1X 的專有模型 Redwood AI 中。

- 「安德的遊戲」策略: 類似科幻概念,機器人透過觀察「寄宿」在其體內的專家(人類)來學習。這使得 1X 能夠完全繞過 Sim-to-Real 的鴻溝,因為訓練資料 就是 真實世界數據。

4.2 隱私與安全作為數據約束

與網路爬蟲不同,在用戶家中收集數據引入了嚴格的隱私約束。1X 實施了一種類似「星海爭霸」(Starcraft-like)的操作介面來解決此問題。

- 匿名化 (Anonymization): 操作員通常看到的是經過模糊處理或語意分割的世界版本,以保護用戶身份。

- 任務特定視野 (Task-Specific Visibility): 當用戶請求協助處理特定物體時,操作員的視野可能被限制在該物體的互動區域內,防止他們窺視房間其他角落。

- 本地存儲 (Local Storage): 數據首先在本地存儲並加密,據稱用戶擁有對上傳用於訓練之數據的控制權。

這種方法承認了「物理智能」無法被竊取或爬取;它必須是 被授權 且 協作生成 的。因此,世界模型的門檻不僅僅是算力(如 LLM),更是 信任 與 物理接觸權。

4.3 比較分析:Tesla Optimus 的路徑

Tesla 為其 Optimus 機器人採取了平行但不同的數據策略。

- 來源差異: Tesla 利用其 FSD(全自動駕駛)車隊的龐大視頻數據集來訓練世界模型的視覺骨幹。

- 遷移學習: 為汽車開發的「神經世界模擬器」(預測道路佈局、移動物體)正被調整用於雙足導航。然而,Tesla 同樣依賴遙操作(使用動作捕捉套裝)來教導 Optimus 具體的操控任務(如疊襯衫),因為這是汽車數據中缺失的部分。

- 統一架構: Tesla 的目標是單一的端到端神經網絡,直接輸入視頻並輸出執行器指令,最大限度減少顯式代碼——他們稱之為「軟體 2.0」時刻。

5. 2025 年世界模型的技術版圖

當前領域已湧現出多種解決「世界建模」問題的路徑。我們可以根據其輸入/輸出模態及擬真度目標將其分類。

5.1 生成式模擬器:Google Genie 2 & 3

Google DeepMind 的 Genie (Generative Interactive Environments) 代表了「生成式」學派。

- 機制: Genie 接受單個圖像或提示詞,並生成一個互動式、可遊玩的 2D(Genie 1)及現在的 3D(Genie 2/3)環境。

- 創新: 它從視頻中學習「潛在動作」(Latent Actions)。即使沒有明確的標籤,Genie 也能分析幀與幀之間的變化,推斷出導致過渡的可能動作(例如:「跳躍」、「右移」)。

- 應用: Genie 充當訓練其他智能體的「世界基礎模型」。研究人員無需手動構建模擬器,而是可以利用 Genie「夢想」出一個訓練環境,然後在該夢境中訓練機器人智能體。

- 發布進程: Genie 2 於 2024 年底推出,具備更強的場景與動力學建模;Genie 3 預計於 2025 年中期發布,將具備完全互動的可遊玩世界生成能力。

5.2 自動駕駛世界模型:Wayve GAIA-1 & GAIA-2

Wayve 的 GAIA (Generative AI for Autonomy) 系列專注於高風險的駕駛領域。

- 多模態輸入: GAIA-1/2 接受視頻、文本與動作指令。它可以根據「開始下雨」或「前車突然煞車」等提示生成逼真的未來駕駛場景。

- 動作條件化 (Action-Conditioning): 與 Sora 不同,GAIA 深度依賴於本車(Ego-vehicle)的動作。它預測世界如何 響應 車輛的轉向與加速,使其成為真正的閉環模擬器。

- 技術躍進: GAIA-2 引入了視頻 Tokenizer 與潛在擴散模型(Latent Diffusion),並結合流匹配(Flow Matching)技術,以確保長視野下的時間連貫性,解決了早期模型中常見的「夢境般」不穩定性。

5.3 「反生成」模型:Meta V-JEPA

如前所述,Meta 的 V-JEPA 拒絕像素生成。

- 核心焦點: 擅長「掩碼建模」(Masked Modeling)——在空間與時間上隱藏視頻的一部分,並在潛在空間中預測缺失信息。

- 效率: 由於摒棄了渲染紋理的需求,其計算效率遠高於 Genie 或 GAIA,這使得在機器人上進行快速訓練與潛在的實時推論成為可能。

- 物理直覺: 測試顯示 V-JEPA 發展出了對重力與物體恆存性的強大「直覺」,當展示物理上不可能的視頻時,模型會產生高誤差信號。

6. 挑戰與未來展望

儘管進展顯著,世界模型領域仍面臨與 LLM 截然不同的障礙。

6.1 複合誤差的詛咒 (Compounding Errors)

在任何自回歸系統中,預測的小誤差會隨時間積累。在文本中,這導致模型「離題」。但在控制機器人的世界模型中,預測杯子位置的 1% 誤差意味著三秒後機器人會打翻杯子。這就是長視野規劃中的 複合誤差 問題。

- 解決方案: 研究人員正轉向「分層」(Hierarchical)規劃,由高層模型(基於 LLM 邏輯)規劃目標,低層世界模型處理即時物理(短視野控制),從而減少誤差積累窗口。

6.2 物理的「幻覺」

LLM 的「AI 幻覺」是資訊錯誤;世界模型的幻覺則是對守恆定律的違反。當前的視頻生成模型仍難以保持一致性——物體大小改變、消失或以物理上不可能的弧線移動。

- 影響: 在「幻覺」模擬器上訓練的機器人將學會利用不存在的物理特性(例如推著一個虛幻的力),導致在現實世界中徹底失敗。

6.3 基準測試:WorldScore

為了量化世界模型的進展,學界推出了 WorldScore 基準。這是第一個針對世界生成的統一評估框架,涵蓋 3D、4D 及視頻生成模型。它從三個維度進行評估:可控性(Controllability)、質量(Quality)與動力學(Dynamics),特別強調模型對相機軌跡與物理法則的遵循程度,為該領域提供了標準化的度量衡。

6.4 融合:神經符號的合成

研究的最終方向並非在 LLM 與世界模型之間二選一,而是融合。

- LLM 作為前額葉: 負責邏輯、規劃與語意理解。

- 世界模型作為運動皮層/小腦: 負責物理、空間操作與即時感官預測。

- 統一智能體: 如 Google 的 Gemini 正開始整合這些能力,交錯處理視頻與文本以推理世界。

7. 結論

2024 至 2025 年的轉型標誌著 AI 從「文本時代」邁向「具身時代」。LLM 的局限性——缺乏接地性與物理直覺——已表露無遺,迫使世界模型必須崛起。這些系統在訓練資料(物理 vs. 邏輯)與目標(潛在狀態預測 vs. Token 生成)上與 LLM 有著本質區別。

新時代的瓶頸不再僅是算法設計,而是 物理數據的後勤學。當 LLM 可以通過爬取網路訓練時,世界模型要求我們必須在世界中 行動 才能理解它。這提升了以下三者的價值:

- 遙操作數據: AI 時代的新石油。

- Sim-to-Real 管道: 將合成數據轉化為可用資源的煉油廠。

- 潛在架構 (JEPA): 允許高效學習的引擎。

1X Neo 的案例——部署硬體以收割數據進而改進軟體——代表了未來十年機器人技術的範本。我們正見證 AI 從 書寫 世界轉變為 棲息 於世界之中。

Member discussion